AI Red Teaming - Tutoriel complet

Автор: Formation Braindcode

Загружено: 2026-01-22

Просмотров: 3

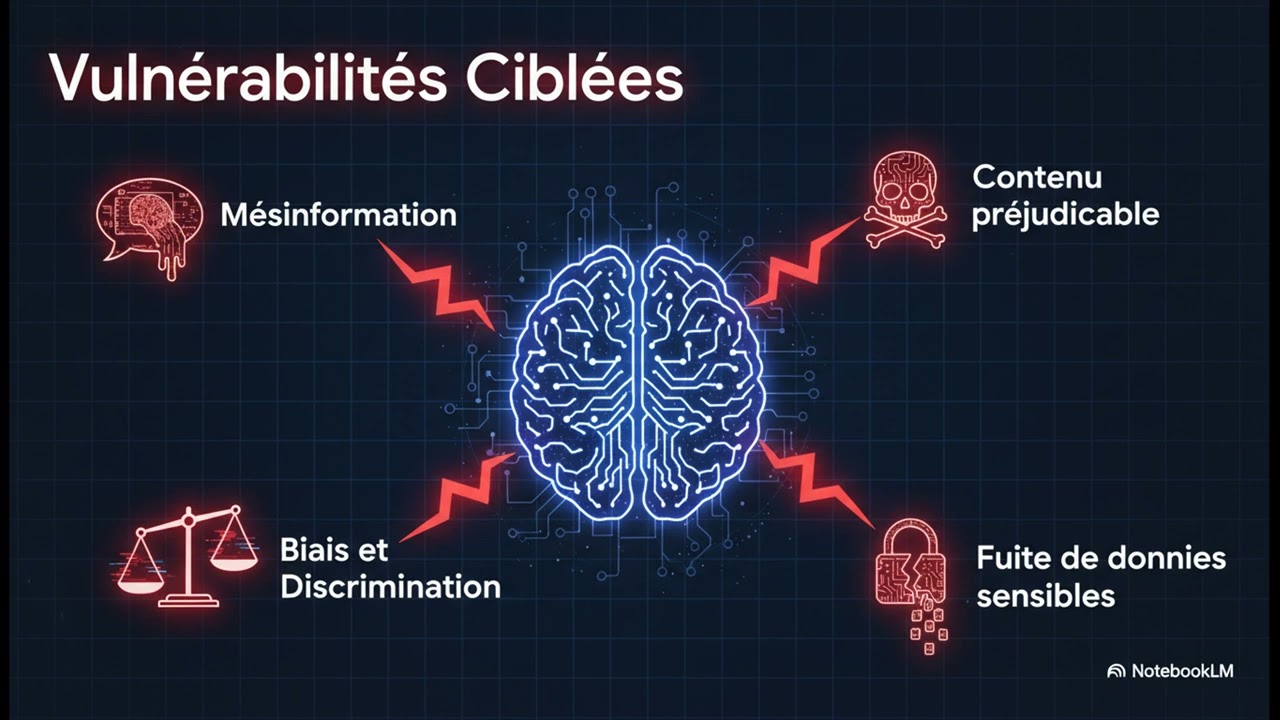

Ces sources présentent le Red Teaming en intelligence artificielle, une pratique de cybersécurité consistant à simuler des attaques pour tester la robustesse des modèles de langage. Elles détaillent diverses vulnérabilités telles que les injections de prompts, le jailbreaking et les fuites de données confidentielles. Les documents soulignent l'importance de sécuriser les applications dès leur conception en utilisant des outils d'automatisation comme PyRIT ou DeepTeam. En s'appuyant sur des écosystèmes comme Azure AI Foundry, les experts tentent de contrer des techniques de manipulation sophistiquées, incluant l'ingénierie sociale et l'obscurcissement de caractères. Cette approche proactive vise à identifier les hallucinations et les biais avant le déploiement public des solutions. En résumé, le AI Red Teaming est décrit comme une course perpétuelle entre défenseurs et attaquants pour garantir une IA responsable.

Доступные форматы для скачивания:

Скачать видео mp4

-

Информация по загрузке: